কন্টেন্ট

প্রশ্ন:

কৃত্রিম পুনরাবৃত্ত নিউরাল নেটওয়ার্কগুলি কেন প্রশিক্ষণ প্রায়শই শক্ত?

উত্তর:

কৃত্রিম পুনরাবৃত্ত নিউরাল নেটওয়ার্কগুলি প্রশিক্ষণের অসুবিধা তাদের জটিলতার সাথে সম্পর্কিত।

পুনরাবৃত্ত নিউরাল নেটওয়ার্কগুলি কেন প্রশিক্ষণ করা শক্ত তা বোঝানোর একটি সহজ উপায় হ'ল তারা ফিডফোরওয়ার্ড নিউরাল নেটওয়ার্ক নয়।

ফিডফোরওয়ার্ড নিউরাল নেটওয়ার্কগুলিতে, সিগন্যালগুলি কেবল এক পথে চলে। সিগন্যাল একটি ইনপুট স্তর থেকে বিভিন্ন লুকানো স্তরগুলিতে চলে যায় এবং এগিয়ে চলে যায় এবং সিস্টেমের আউটপুট স্তরে চলে যায়।

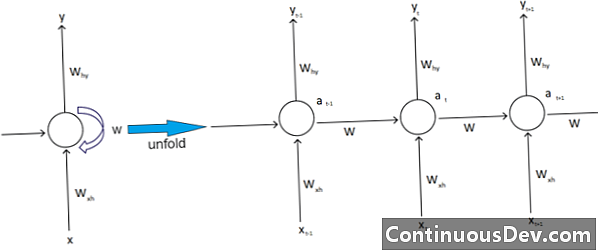

বিপরীতে, পুনরাবৃত্ত নিউরাল নেটওয়ার্ক এবং অন্যান্য বিভিন্ন ধরণের নিউরাল নেটওয়ার্কগুলির মধ্যে আরও জটিল সংকেত চলন রয়েছে। "প্রতিক্রিয়া" নেটওয়ার্ক হিসাবে শ্রেণিবদ্ধ, পুনরাবৃত্ত নিউরাল নেটওয়ার্কগুলি সামনে এবং পিছনে উভয়ই সিগন্যাল থাকতে পারে এবং এতে নেটওয়ার্কে বিভিন্ন "লুপ" থাকতে পারে যেখানে নম্বর বা মানগুলি নেটওয়ার্কে ফেরত দেওয়া হয়। বিশেষজ্ঞরা এটিকে তাদের স্মৃতির সাথে যুক্ত পুনরাবৃত্ত নিউরাল নেটওয়ার্কগুলির দিকের সাথে যুক্ত করেন associate

এছাড়াও, পুনরাবৃত্ত নিউরাল নেটওয়ার্কগুলিকে প্রভাবিত করে এমন আরও একটি জটিলতা রয়েছে। প্রাকৃতিক ভাষা প্রক্রিয়াজাতকরণের ক্ষেত্রে এর একটি দুর্দান্ত উদাহরণ।

পরিশীলিত প্রাকৃতিক ভাষা প্রক্রিয়াকরণে, নিউরাল নেটওয়ার্কের জিনিসগুলি মনে রাখতে সক্ষম হওয়া প্রয়োজন। এটি কনও ইনপুট গ্রহণ করা প্রয়োজন। ধরুন এমন একটি প্রোগ্রাম রয়েছে যা অন্য শব্দের বাক্যটির মধ্যে একটি শব্দ বিশ্লেষণ বা ভবিষ্যদ্বাণী করতে চায়। উদাহরণস্বরূপ, সিস্টেমটি মূল্যায়নের জন্য পাঁচটি শব্দের একটি নির্দিষ্ট দৈর্ঘ্য থাকতে পারে। এর অর্থ এই শব্দগুলির শঙ্কুতে "মনে রাখতে" বা প্রশিক্ষণের দক্ষতার সাথে নিউরাল নেটওয়ার্কের এই প্রতিটি শব্দের জন্য ইনপুট থাকতে হবে। এই এবং অন্যান্য অনুরূপ কারণে, পুনরাবৃত্ত নিউরাল নেটওয়ার্কগুলিতে সাধারণত সিস্টেমে এই সামান্য লুকানো লুপ এবং ফিডব্যাক থাকে।

বিশেষজ্ঞরা শোক প্রকাশ করেছেন যে এই জটিলতাগুলি নেটওয়ার্কগুলিকে প্রশিক্ষিত করতে অসুবিধা সৃষ্টি করে। এটি ব্যাখ্যা করার সর্বাধিক সাধারণ উপায়গুলির মধ্যে একটি হ'ল বিস্ফোরণ এবং গ্রেডিয়েন্ট সমস্যার অদৃশ্য। মূলত, নেটওয়ার্কের ওজনগুলি হয় বিপুল সংখ্যক পাসের সাথে মানগুলি বিস্ফোরিত বা বিলুপ্ত করে।

নিউরাল নেটওয়ার্কের অগ্রদূত জিওফ হিন্টন ওয়েবে এই ঘটনাটি ব্যাখ্যা করে বলেছেন যে পশ্চাদপদ রৈখিক পাসগুলি ছোট ওজনগুলি দ্রুততর আকারে সঙ্কুচিত করতে এবং বৃহত্তর ওজন বিস্ফোরণ ঘটায়।

এই সমস্যাটি তিনি চালিয়ে যান, দীর্ঘ ক্রমগুলি এবং আরও অনেক সময় পদক্ষেপের সাথে আরও খারাপ হয়, এতে সংকেতগুলি বৃদ্ধি পায় বা ক্ষয় হয়। ওজন সূচনা সাহায্য করতে পারে, কিন্তু এই চ্যালেঞ্জগুলি পুনরাবৃত্ত নিউরাল নেটওয়ার্ক মডেলটিতে অন্তর্নির্মিত। থেরেস সর্বদা তাদের বিশেষ নকশা এবং বিল্ডের সাথে যুক্ত সমস্যা হতে চলেছে। মূলত, কিছু জটিল ধরণের নিউরাল নেটওয়ার্কগুলি সহজেই সেগুলি পরিচালনা করার জন্য আমাদের দক্ষতাকে অস্বীকার করে। আমরা কার্যত অসীম পরিমাণে জটিলতা তৈরি করতে পারি, তবে আমরা প্রায়শই অনুমানযোগ্যতা এবং স্কেলাবিলিটি চ্যালেঞ্জগুলি বৃদ্ধি পেতে দেখি।